https://ria.ru/20221113/prognozy-1830927122.html

Апокалипсис не сегодня. Как и когда вымрет человечество

Апокалипсис не сегодня. Как и когда вымрет человечество — РИА Новости, 14.11.2022

Апокалипсис не сегодня. Как и когда вымрет человечество

Ученые всерьез исследуют возможность глобальной катастрофы, способной уничтожить человечество. О наиболее вероятных сценариях и о том, стоит ли их опасаться — в РИА Новости, 14.11.2022

2022-11-13T08:00

2022-11-13T08:00

2022-11-14T10:58

наука

оксфордский университет

оон

youtube

земля

оксфорд

россия

сергей капица

/html/head/meta[@name=’og:title’]/@content

/html/head/meta[@name=’og:description’]/@content

https://cdnn21.img.ria.ru/images/07e4/06/16/1573327115_0:308:802:759_1920x0_80_0_0_3630d70c2c8c8292f597bf5d4f1fb7f1.jpg

МОСКВА, 13 ноя — РИА Новости, Николай Гурьянов. Ученые всерьез исследуют возможность глобальной катастрофы, способной уничтожить человечество. О наиболее вероятных сценариях и о том, стоит ли их опасаться — в материале РИА Новости.»Мусор на входе, мусор на выходе»СМИ, в том числе в России, опубликовали предсказания суперкомпьютера о том, что к 2050-му наступит «конец света». На самом деле речь идет о прогнозе полувековой давности, хотя в британском таблоиде, послужившем источником перепечаток, это подали как новость.В 2018-м Австралийская радиовещательная корпорация (ABC) достала из архивов и разместила на YouTube ролик ноября 1973-го о компьютерной программе World 1 («Мир-1″), созданной системологом Джеем Форрестером из Массачусетского технологического университета.Из закадрового текста следует, что самая современная на тот момент вычислительная техника (которую по нынешним меркам нельзя назвать суперкомпьютером) не видит в нашем будущем ничего хорошего.»К 2020-му планета окажется в критическом состоянии, — сообщалось в репортаже. — Если ничего с этим не делать, качество жизни упадет до нуля. Загрязнение станет настолько серьезным, что начнет убивать людей. Это приведет к сокращению населения до уровня ниже 1900 года. С 2040-го по 2050-й цивилизованная жизнь, какой мы ее знаем, перестанет существовать».В сюжете австралийского телевидения были, мягко говоря, неточности и преувеличения.В 1972-м Римский клуб — международный аналитический центр, в который от Советского Союза тогда входил физик Сергей Капица — опубликовал доклад «Пределы роста».Документ подготовила группа под руководством американского ученого Денниса Медоуза. На основе разработок Джея Форрестера он создал модель World 3 («Мир-3»). Как следовало из заголовка, задачей было определить пределы роста человеческой популяции и экономического развития планеты. Программа учитывала несколько основных показателей: невозобновляемые ресурсы, промышленный и сельскохозяйственный капитал, капитал сферы услуг, свободную землю, сельхозугодья, городскую и промышленную застройку, неудаляемые загрязнители, численность населения.В результате получили 12 сценариев развития событий. Из них пять, включая базовый, предсказывали увеличение населения планеты до десяти-двенадцати миллиардов человек, а потом — резкий спад до одного-трех миллиардов со значительным понижением уровня жизни. Остальные варианты делились на «благоприятные» (предполагали, в частности, мягкое ограничение рождаемости) и «менее благоприятные». Ни один из них не приводил к «концу цивилизации» или «вымиранию человечества».Сразу после выхода доклад подвергся жесткой критике. «Пределы роста», на наш взгляд, — пустая и вводящая в заблуждение работа. Ее внушительный аппарат компьютерных технологий и системного жаргона <…> берет произвольные предположения, встряхивает их и делает произвольные выводы, которые кажутся научными», — писала The New York Times в апреле 1972-го.Авторы статьи добавляли: «Пределы роста» <…> лучше всего охарактеризовать не как повторное открытие законов природы, а как повторное открытие старейшего принципа информатики: «Мусор на входе, мусор на выходе».Тем не менее в 1988-м экономисты отмечали, что некоторые пророчества Медоуза сбываются.Но ключевая проблема, которая особенно беспокоила Римский клуб в то время — перенаселение — похоже, не угрожает цивилизации. ООН прогнозирует, что в 2080-х на планете будет около 10,4 миллиарда человек, после чего рост прекратится.Более современные прогнозыЕсть и более свежие научные предсказания апокалипсиса. В 2015-м исследователи из шведского Фонда глобальных проблем в сотрудничестве с Институтом будущего человечества Оксфордского университета выпустили отчет, в котором описали 12 наиболее вероятных глобальных рисков на ближайшие 100 лет.Оценивали угрозы на основе изучения профильной научной литературы и приоритетов тех организаций, которые должны их купировать. Пришли к следующим выводам.Вероятность уничтожения человечества искусственным интеллектом — самая высокая, десять процентов. ИИ может стремиться к саморазвитию и потреблению максимального количества ресурсов, и не исключено, что сочтет людей помехой на этом пути. А у человечества, скорее всего, не найдется инструментов, чтобы контролировать сверхразум. С другой стороны, если ИИ не выйдет из-под контроля, он решит большинство других наших экзистенциальных проблем.Шансы на ядерный армагеддон — один к двадцати. Столько же — у гибельной пандемии (до ковида еще было пять лет), фатального изменения климата (правда, не за один, а за два века) и пока неизвестных глобальных угроз.Возможность апокалипсиса из-за синтетической биологии (прежде всего имеется в виду распространение искусственного патогена) — один процент. Чуть меньше вероятность гибели после изобретения супероружия с помощью нанотехнологий и экологического коллапса.Глобальная катастрофа из-за падения метеорита — одна сотая процента, из-за извержения супервулкана — две тысячных.Что естественно, то не без вымиранияИз всех существовавших на Земле видов животных более 99 процентов вымерли — по естественным причинам. Хотя для Homo sapiens и существуют антропогенные экзистенциальные риски, наш конец, скорее всего, наступит в результате природных событий — изменения экологических условий, эволюционной гонки, извержения вулкана или удара метеорита. Вероятность этого в 2019-м подсчитали ученые из Оксфорда.Человечеству около 200 тысяч лет. Другие виды гоминин (такие как Homo erectus и Homo habilis) прожили, по разным оценкам, от 620 до 970 тысяч лет. Массовые вымирания происходили примерно раз в 100 миллионов лет, масштабные извержения вулканов — 20-30 миллионов, столкновения Земли с крупным небесным телом — 15 миллионов.Исходя из этого, подсчитали, что шансы исчезновения человечества в ближайшее время ниже, чем один к 14 тысячам. А скорее всего, и того меньше — один к 87 тысячам. И это еще, как выражаются авторы расчетов, “консервативные оценки”.Отметим, что все подобные работы не учитывают другие космические опасности. Например, гамма-всплески — масштабные выбросы энергии, способные моментально испепелить нашу планету.Зебр жалко, людей нетДругая команда ученых из Оксфорда в том же 2019-м выяснила, что гибель всего человечества не так уж сильно беспокоит людей. Участников эксперимента (две с половиной тысячи граждан США и Великобритании) попросили ответить на вопрос, что хуже — полное исчезновение популяции Homo sapiens по той или иной причине или гибель 80 процентов. Большинство указали на второй вариант.»То есть они не считают вымирание человечества однозначно плохим», — отмечают авторы работы.Это объяснили тем, что люди задумались о выживании в постапокалиптическом мире. Примечательно, что при ответе на тот же вопрос, но относительно зебр, выбор был противоположным.В то же время респонденты оценили полное исчезновение нашего вида как нечто исключительно плохое, когда условия задания изменились: было сказано, что для уцелевших в глобальном катаклизме двадцати процентов наступит жизнь «лучше, чем сегодня, во всех мыслимых отношениях».В отличие от алармистских сюжетов в СМИ, современные научные прогнозы не предполагают скорой гибели человечества. Но и глобального улучшения жизни в обозримом будущем ученые не обещают.

https://ria.ru/20221110/vymiranie-1830221701.html

https://ria.ru/20221111/arktika-1830590833.html

https://ria.ru/20221028/virusy-1826888546.html

https://ria.ru/20221022/chuma-1825760546.html

земля

оксфорд

россия

РИА Новости

internet-group@rian.ru

7 495 645-6601

ФГУП МИА «Россия сегодня»

https://xn--c1acbl2abdlkab1og.xn--p1ai/awards/

2022

РИА Новости

internet-group@rian.ru

7 495 645-6601

ФГУП МИА «Россия сегодня»

https://xn--c1acbl2abdlkab1og.xn--p1ai/awards/

Новости

ru-RU

https://ria.ru/docs/about/copyright.html

https://xn--c1acbl2abdlkab1og.xn--p1ai/

РИА Новости

internet-group@rian.ru

7 495 645-6601

ФГУП МИА «Россия сегодня»

https://xn--c1acbl2abdlkab1og.xn--p1ai/awards/

https://cdnn21.img.ria.ru/images/07e4/06/16/1573327115_0:233:802:835_1920x0_80_0_0_43d3892bee9719d7e5e38e53df87fc5c.jpg

РИА Новости

internet-group@rian.ru

7 495 645-6601

ФГУП МИА «Россия сегодня»

https://xn--c1acbl2abdlkab1og.xn--p1ai/awards/

РИА Новости

internet-group@rian.ru

7 495 645-6601

ФГУП МИА «Россия сегодня»

https://xn--c1acbl2abdlkab1og.xn--p1ai/awards/

оксфордский университет, оон, youtube, земля, оксфорд, россия, сергей капица

Наука, Оксфордский университет, ООН, YouTube, Земля, Оксфорд, Россия, Сергей Капица

МОСКВА, 13 ноя — РИА Новости, Николай Гурьянов. Ученые всерьез исследуют возможность глобальной катастрофы, способной уничтожить человечество. О наиболее вероятных сценариях и о том, стоит ли их опасаться — в материале РИА Новости.

«Мусор на входе, мусор на выходе»

СМИ, в том числе в России, опубликовали предсказания суперкомпьютера о том, что к 2050-му наступит «конец света». На самом деле речь идет о прогнозе полувековой давности, хотя в британском

таблоиде

, послужившем источником перепечаток, это подали как новость.

В 2018-м Австралийская радиовещательная корпорация (ABC) достала из архивов и разместила на YouTube

ролик

ноября 1973-го о компьютерной программе World 1 («Мир-1»), созданной системологом Джеем Форрестером из Массачусетского технологического университета.

Из закадрового текста следует, что самая современная на тот момент вычислительная техника (которую по нынешним меркам нельзя назвать суперкомпьютером) не видит в нашем будущем ничего хорошего.

«К 2020-му планета окажется в критическом состоянии, — сообщалось в репортаже. — Если ничего с этим не делать, качество жизни упадет до нуля. Загрязнение станет настолько серьезным, что начнет убивать людей. Это приведет к сокращению населения до уровня ниже 1900 года. С 2040-го по 2050-й цивилизованная жизнь, какой мы ее знаем, перестанет существовать».

В сюжете австралийского телевидения были, мягко говоря, неточности и преувеличения.

В 1972-м Римский клуб — международный аналитический центр, в который от Советского Союза тогда входил физик Сергей Капица — опубликовал доклад «Пределы роста».

Документ подготовила группа под руководством американского ученого Денниса Медоуза. На основе разработок Джея Форрестера он создал модель World 3 («Мир-3»). Как следовало из заголовка, задачей было определить пределы роста человеческой популяции и экономического развития планеты. Программа учитывала несколько основных показателей: невозобновляемые ресурсы, промышленный и сельскохозяйственный капитал, капитал сферы услуг, свободную землю, сельхозугодья, городскую и промышленную застройку, неудаляемые загрязнители, численность населения.

В результате получили 12 сценариев развития событий. Из них пять, включая базовый, предсказывали увеличение населения планеты до десяти-двенадцати миллиардов человек, а потом — резкий спад до одного-трех миллиардов со значительным понижением уровня жизни. Остальные варианты делились на «благоприятные» (предполагали, в частности, мягкое ограничение рождаемости) и «менее благоприятные». Ни один из них не приводил к «концу цивилизации» или «вымиранию человечества».

Сразу после выхода доклад подвергся жесткой критике. «Пределы роста», на наш взгляд, — пустая и вводящая в заблуждение работа. Ее внушительный аппарат компьютерных технологий и системного жаргона <…> берет произвольные предположения, встряхивает их и делает произвольные выводы, которые кажутся научными», — писала

The New York Times

в апреле 1972-го.

Авторы статьи добавляли: «Пределы роста» <…> лучше всего охарактеризовать не как повторное открытие законов природы, а как повторное открытие старейшего принципа информатики: «Мусор на входе, мусор на выходе».

Тем не менее в 1988-м экономисты

отмечали

, что некоторые пророчества Медоуза сбываются.

Но ключевая проблема, которая особенно

беспокоила

Римский клуб в то время — перенаселение — похоже,

не угрожает

цивилизации. ООН прогнозирует, что в 2080-х на планете будет около 10,4 миллиарда человек, после чего рост прекратится.

Более современные прогнозы

Есть и более свежие научные предсказания апокалипсиса. В 2015-м исследователи из шведского Фонда глобальных проблем в сотрудничестве с Институтом будущего человечества Оксфордского университета выпустили

отчет

, в котором описали 12 наиболее вероятных глобальных рисков на ближайшие 100 лет.

Оценивали угрозы на основе изучения профильной научной литературы и приоритетов тех организаций, которые должны их купировать. Пришли к следующим выводам.

Вероятность уничтожения человечества искусственным интеллектом — самая высокая, десять процентов. ИИ может стремиться к саморазвитию и потреблению максимального количества ресурсов, и не исключено, что сочтет людей помехой на этом пути. А у человечества, скорее всего, не найдется инструментов, чтобы контролировать сверхразум. С другой стороны, если ИИ не выйдет из-под контроля, он решит большинство других наших экзистенциальных проблем.

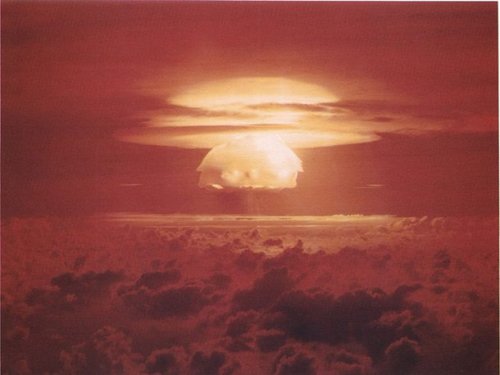

Шансы на ядерный армагеддон — один к двадцати. Столько же — у гибельной пандемии (до ковида еще было пять лет), фатального изменения климата (правда, не за один, а за два века) и пока неизвестных глобальных угроз.

Возможность апокалипсиса из-за синтетической биологии (прежде всего имеется в виду распространение искусственного патогена) — один процент. Чуть меньше вероятность гибели после изобретения супероружия с помощью нанотехнологий и экологического коллапса.

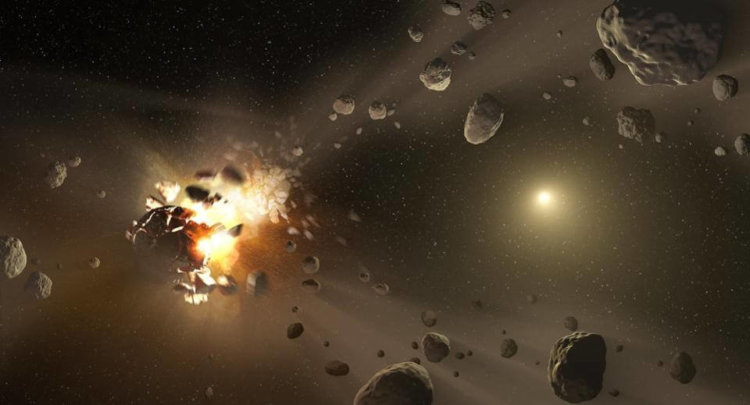

Глобальная катастрофа из-за падения метеорита — одна сотая процента, из-за извержения супервулкана — две тысячных.

Что естественно, то не без вымирания

Из всех существовавших на Земле видов животных более 99 процентов вымерли — по естественным причинам. Хотя для Homo sapiens и существуют антропогенные экзистенциальные риски, наш конец, скорее всего, наступит в результате природных событий — изменения экологических условий, эволюционной гонки, извержения вулкана или удара метеорита. Вероятность этого в 2019-м

подсчитали

ученые из Оксфорда.

Человечеству около 200 тысяч лет. Другие виды гоминин (такие как Homo erectus и Homo habilis) прожили, по разным оценкам, от 620 до 970 тысяч лет. Массовые вымирания происходили примерно раз в 100 миллионов лет, масштабные извержения вулканов — 20-30 миллионов, столкновения Земли с крупным небесным телом — 15 миллионов.

Исходя из этого, подсчитали, что шансы исчезновения человечества в ближайшее время ниже, чем один к 14 тысячам. А скорее всего, и того меньше — один к 87 тысячам. И это еще, как выражаются авторы расчетов, “консервативные оценки”.

Отметим, что все подобные работы не учитывают другие космические опасности. Например, гамма-всплески — масштабные выбросы энергии, способные моментально испепелить нашу планету.

Зебр жалко, людей нет

Другая команда ученых из Оксфорда в том же 2019-м

выяснила

, что гибель всего человечества не так уж сильно беспокоит людей. Участников эксперимента (две с половиной тысячи граждан США и Великобритании) попросили ответить на вопрос, что хуже — полное исчезновение популяции Homo sapiens по той или иной причине или гибель 80 процентов. Большинство указали на второй вариант.

«То есть они не считают вымирание человечества однозначно плохим», — отмечают авторы работы.

Это объяснили тем, что люди задумались о выживании в постапокалиптическом мире. Примечательно, что при ответе на тот же вопрос, но относительно зебр, выбор был противоположным.

В то же время респонденты оценили полное исчезновение нашего вида как нечто исключительно плохое, когда условия задания изменились: было сказано, что для уцелевших в глобальном катаклизме двадцати процентов наступит жизнь «лучше, чем сегодня, во всех мыслимых отношениях».

В отличие от алармистских сюжетов в СМИ, современные научные прогнозы не предполагают скорой гибели человечества. Но и глобального улучшения жизни в обозримом будущем ученые не обещают.

https://sputnik-abkhazia.ru/20221113/apokalipsis-ne-segodnya-kak-i-kogda-vymret-chelovechestvo-1042603686.html

Апокалипсис не сегодня: как и когда вымрет человечество

Апокалипсис не сегодня: как и когда вымрет человечество

Ученые всерьез исследуют возможность глобальной катастрофы, способной уничтожить человечество. 13.11.2022, Sputnik Абхазия

2022-11-13T11:25+0300

2022-11-13T11:25+0300

2022-11-13T11:41+0300

в мире

наука

/html/head/meta[@name=’og:title’]/@content

/html/head/meta[@name=’og:description’]/@content

https://cdnn1.img.sputnik-abkhazia.info/img/07e6/02/12/1037644939_0:131:2501:1537_1920x0_80_0_0_18045cf16f54af8a5d157ab9537060da.jpg

СУХУМ, 13 ноя — Sputnik. О наиболее вероятных сценариях и о том, стоит ли их опасаться — в материале Николая Гурьянова для РИА Новости.»Мусор на входе, мусор на выходе»СМИ, в том числе в России, опубликовали предсказания суперкомпьютера о том, что к 2050-му наступит «конец света». На самом деле речь идет о прогнозе полувековой давности, хотя в британском таблоиде, послужившем источником перепечаток, это подали как новость.В 2018-м Австралийская радиовещательная корпорация (ABC) достала из архивов и разместила на YouTube ролик ноября 1973-го о компьютерной программе World 1 («Мир-1»), созданной системологом Джеем Форрестером из Массачусетского технологического университета.Из закадрового текста следует, что самая современная на тот момент вычислительная техника (которую по нынешним меркам нельзя назвать суперкомпьютером) не видит в нашем будущем ничего хорошего.В сюжете австралийского телевидения были, мягко говоря, неточности и преувеличения.В 1972-м Римский клуб — международный аналитический центр, в который от Советского Союза тогда входил великий физик Сергей Капица — опубликовал доклад «Пределы роста».Документ подготовила группа под руководством американского ученого Денниса Медоуза. На основе разработок Джея Форрестера он создал модель World 3 («Мир-3»). Как следовало из заголовка, задачей было определить пределы роста человеческой популяции и экономического развития планеты. Программа учитывала несколько основных показателей: невозобновляемые ресурсы, промышленный и сельскохозяйственный капитал, капитал сферы услуг, свободную землю, сельхозугодья, городскую и промышленную застройку, неудаляемые загрязнители, численность населения.В результате получили 12 сценариев развития событий. Из них пять, включая базовый, предсказывали увеличение населения планеты до десяти-двенадцати миллиардов человек, а потом — резкий спад до одного-трех миллиардов со значительным понижением уровня жизни. Остальные варианты делились на «благоприятные» (предполагали, в частности, мягкое ограничение рождаемости) и «менее благоприятные». Ни один из них не приводил к «концу цивилизации» или «вымиранию человечества».Сразу после выхода доклад подвергся жесткой критике. «Пределы роста», на наш взгляд, — пустая и вводящая в заблуждение работа. Ее внушительный аппарат компьютерных технологий и системного жаргона <…> берет произвольные предположения, встряхивает их и делает произвольные выводы, которые кажутся научными», — писала The New York Times в апреле 1972-го.Тем не менее в 1988-м экономисты отмечали, что некоторые пророчества Медоуза сбываются.Но ключевая проблема, которая особенно беспокоила Римский клуб в то время — перенаселение — похоже, не угрожает цивилизации. ООН прогнозирует, что в 2080-х на планете будет около 10,4 миллиарда человек, после чего рост прекратится.Более современные прогнозыЕсть и более свежие научные предсказания апокалипсиса. В 2015-м исследователи из шведского Фонда глобальных проблем в сотрудничестве с Институтом будущего человечества Оксфордского университета выпустили отчет, в котором описали 12 наиболее вероятных глобальных рисков на ближайшие 100 лет.Оценивали угрозы на основе изучения профильной научной литературы и приоритетов тех организаций, которые должны их купировать. Пришли к следующим выводам.Вероятность уничтожения человечества искусственным интеллектом — самая высокая, десять процентов. ИИ может стремиться к саморазвитию и потреблению максимального количества ресурсов, и не исключено, что сочтет людей помехой на этом пути. А у человечества, скорее всего, не найдется инструментов, чтобы контролировать сверхразум. С другой стороны, если ИИ не выйдет из-под контроля, он решит большинство других наших экзистенциальных проблем.Шансы на ядерный армагеддон — один к двадцати. Столько же — у гибельной пандемии (до ковида еще было пять лет), фатального изменения климата (правда, не за один, а за два века) и пока неизвестных глобальных угроз.Возможность апокалипсиса из-за синтетической биологии (прежде всего имеется в виду распространение искусственного патогена) — один процент. Чуть меньше вероятность гибели после изобретения супероружия с помощью нанотехнологий и экологического коллапса.Глобальная катастрофа из-за падения метеорита — одна сотая процента, из-за извержения супервулкана — две тысячных.Что естественно, то не без вымиранияИз всех существовавших на Земле видов животных более 99 процентов вымерли — по естественным причинам. Хотя для Homo sapiens и существуют антропогенные экзистенциальные риски, наш конец, скорее всего, наступит в результате природных событий — изменения экологических условий, эволюционной гонки, извержения вулкана или удара метеорита. Вероятность этого в 2019-м подсчитали ученые из Оксфорда.Исходя из этого, подсчитали, что шансы исчезновения человечества в ближайшее время ниже, чем один к 14 тысячам. А скорее всего, и того меньше — один к 87 тысячам. И это еще, как выражаются авторы расчетов, “консервативные оценки”.Отметим, что все подобные работы не учитывают другие космические опасности. Например, гамма-всплески — масштабные выбросы энергии, способные моментально испепелить нашу планету.Зебр жалко, людей нетДругая команда ученых из Оксфорда в том же 2019-м выяснила, что гибель всего человечества не так уж сильно беспокоит людей. Участников эксперимента (две с половиной тысячи граждан США и Великобритании) попросили ответить на вопрос, что хуже — полное исчезновение популяции Homo sapiens по той или иной причине или гибель 80 процентов. Большинство указали на второй вариант.»То есть они не считают вымирание человечества однозначно плохим», — отмечают авторы работы.Это объяснили тем, что люди задумались о выживании в постапокалиптическом мире. Примечательно, что при ответе на тот же вопрос, но относительно зебр, выбор был противоположным.В то же время респонденты оценили полное исчезновение нашего вида как нечто исключительно плохое, когда условия задания изменились: было сказано, что для уцелевших в глобальном катаклизме двадцати процентов наступит жизнь «лучше, чем сегодня, во всех мыслимых отношениях».В отличие от алармистских сюжетов в СМИ, современные научные прогнозы не предполагают скорой гибели человечества. Но и глобального улучшения жизни в обозримом будущем ученые не обещают.

https://sputnik-abkhazia.ru/20221109/superkompyuter-nazval-datu-kontsa-sveta-1042545966.html

Sputnik Абхазия

media@sputniknews.com

+74956456601

MIA „Rosiya Segodnya“

2022

Sputnik Абхазия

media@sputniknews.com

+74956456601

MIA „Rosiya Segodnya“

Новости

ru_AB

Sputnik Абхазия

media@sputniknews.com

+74956456601

MIA „Rosiya Segodnya“

https://cdnn1.img.sputnik-abkhazia.info/img/07e6/02/12/1037644939_138:0:2361:1667_1920x0_80_0_0_73702abdfca0283e2679e5dc94d0fce4.jpg

Sputnik Абхазия

media@sputniknews.com

+74956456601

MIA „Rosiya Segodnya“

в мире, наука

Апокалипсис не сегодня: как и когда вымрет человечество

11:25 13.11.2022 (обновлено: 11:41 13.11.2022)

Подписаться на

Ученые всерьез исследуют возможность глобальной катастрофы, способной уничтожить человечество.

СУХУМ, 13 ноя — Sputnik. О наиболее вероятных сценариях и о том, стоит ли их опасаться — в материале Николая Гурьянова для РИА Новости.

«Мусор на входе, мусор на выходе»

СМИ, в том числе в России, опубликовали предсказания суперкомпьютера о том, что к 2050-му наступит «конец света». На самом деле речь идет о прогнозе полувековой давности, хотя в британском таблоиде, послужившем источником перепечаток, это подали как новость.

В 2018-м Австралийская радиовещательная корпорация (ABC) достала из архивов и разместила на YouTube ролик ноября 1973-го о компьютерной программе World 1 («Мир-1»), созданной системологом Джеем Форрестером из Массачусетского технологического университета.

Из закадрового текста следует, что самая современная на тот момент вычислительная техника (которую по нынешним меркам нельзя назвать суперкомпьютером) не видит в нашем будущем ничего хорошего.

«К 2020-му планета окажется в критическом состоянии, — сообщалось в репортаже. — Если ничего с этим не делать, качество жизни упадет до нуля. Загрязнение станет настолько серьезным, что начнет убивать людей. Это приведет к сокращению населения до уровня ниже 1900 года. С 2040-го по 2050-й цивилизованная жизнь, какой мы ее знаем, перестанет существовать».

В сюжете австралийского телевидения были, мягко говоря, неточности и преувеличения.

В 1972-м Римский клуб — международный аналитический центр, в который от Советского Союза тогда входил великий физик Сергей Капица — опубликовал доклад «Пределы роста».

Документ подготовила группа под руководством американского ученого Денниса Медоуза. На основе разработок Джея Форрестера он создал модель World 3 («Мир-3»). Как следовало из заголовка, задачей было определить пределы роста человеческой популяции и экономического развития планеты. Программа учитывала несколько основных показателей: невозобновляемые ресурсы, промышленный и сельскохозяйственный капитал, капитал сферы услуг, свободную землю, сельхозугодья, городскую и промышленную застройку, неудаляемые загрязнители, численность населения.

В результате получили 12 сценариев развития событий. Из них пять, включая базовый, предсказывали увеличение населения планеты до десяти-двенадцати миллиардов человек, а потом — резкий спад до одного-трех миллиардов со значительным понижением уровня жизни. Остальные варианты делились на «благоприятные» (предполагали, в частности, мягкое ограничение рождаемости) и «менее благоприятные». Ни один из них не приводил к «концу цивилизации» или «вымиранию человечества».

Сразу после выхода доклад подвергся жесткой критике. «Пределы роста», на наш взгляд, — пустая и вводящая в заблуждение работа. Ее внушительный аппарат компьютерных технологий и системного жаргона <…> берет произвольные предположения, встряхивает их и делает произвольные выводы, которые кажутся научными», — писала The New York Times в апреле 1972-го.

Авторы статьи добавляли: «Пределы роста» <…> лучше всего охарактеризовать не как повторное открытие законов природы, а как повторное открытие старейшего принципа информатики: «Мусор на входе, мусор на выходе».

Тем не менее в 1988-м экономисты отмечали, что некоторые пророчества Медоуза сбываются.

Но ключевая проблема, которая особенно беспокоила Римский клуб в то время — перенаселение — похоже, не угрожает цивилизации. ООН прогнозирует, что в 2080-х на планете будет около 10,4 миллиарда человек, после чего рост прекратится.

Более современные прогнозы

Есть и более свежие научные предсказания апокалипсиса. В 2015-м исследователи из шведского Фонда глобальных проблем в сотрудничестве с Институтом будущего человечества Оксфордского университета выпустили отчет, в котором описали 12 наиболее вероятных глобальных рисков на ближайшие 100 лет.

Оценивали угрозы на основе изучения профильной научной литературы и приоритетов тех организаций, которые должны их купировать. Пришли к следующим выводам.

Вероятность уничтожения человечества искусственным интеллектом — самая высокая, десять процентов. ИИ может стремиться к саморазвитию и потреблению максимального количества ресурсов, и не исключено, что сочтет людей помехой на этом пути. А у человечества, скорее всего, не найдется инструментов, чтобы контролировать сверхразум. С другой стороны, если ИИ не выйдет из-под контроля, он решит большинство других наших экзистенциальных проблем.

Шансы на ядерный армагеддон — один к двадцати. Столько же — у гибельной пандемии (до ковида еще было пять лет), фатального изменения климата (правда, не за один, а за два века) и пока неизвестных глобальных угроз.

Возможность апокалипсиса из-за синтетической биологии (прежде всего имеется в виду распространение искусственного патогена) — один процент. Чуть меньше вероятность гибели после изобретения супероружия с помощью нанотехнологий и экологического коллапса.

Глобальная катастрофа из-за падения метеорита — одна сотая процента, из-за извержения супервулкана — две тысячных.

Что естественно, то не без вымирания

Из всех существовавших на Земле видов животных более 99 процентов вымерли — по естественным причинам. Хотя для Homo sapiens и существуют антропогенные экзистенциальные риски, наш конец, скорее всего, наступит в результате природных событий — изменения экологических условий, эволюционной гонки, извержения вулкана или удара метеорита. Вероятность этого в 2019-м подсчитали ученые из Оксфорда.

Человечеству около 200 тысяч лет. Другие виды гоминин (такие как Homo erectus и Homo habilis) прожили, по разным оценкам, от 620 до 970 тысяч лет. Массовые вымирания происходили примерно раз в 100 миллионов лет, масштабные извержения вулканов — 20-30 миллионов, столкновения Земли с крупным небесным телом — 15 миллионов.

Исходя из этого, подсчитали, что шансы исчезновения человечества в ближайшее время ниже, чем один к 14 тысячам. А скорее всего, и того меньше — один к 87 тысячам. И это еще, как выражаются авторы расчетов, “консервативные оценки”.

Отметим, что все подобные работы не учитывают другие космические опасности. Например, гамма-всплески — масштабные выбросы энергии, способные моментально испепелить нашу планету.

Зебр жалко, людей нет

Другая команда ученых из Оксфорда в том же 2019-м выяснила, что гибель всего человечества не так уж сильно беспокоит людей. Участников эксперимента (две с половиной тысячи граждан США и Великобритании) попросили ответить на вопрос, что хуже — полное исчезновение популяции Homo sapiens по той или иной причине или гибель 80 процентов. Большинство указали на второй вариант.

«То есть они не считают вымирание человечества однозначно плохим», — отмечают авторы работы.

Это объяснили тем, что люди задумались о выживании в постапокалиптическом мире. Примечательно, что при ответе на тот же вопрос, но относительно зебр, выбор был противоположным.

В то же время респонденты оценили полное исчезновение нашего вида как нечто исключительно плохое, когда условия задания изменились: было сказано, что для уцелевших в глобальном катаклизме двадцати процентов наступит жизнь «лучше, чем сегодня, во всех мыслимых отношениях».

В отличие от алармистских сюжетов в СМИ, современные научные прогнозы не предполагают скорой гибели человечества. Но и глобального улучшения жизни в обозримом будущем ученые не обещают.

С ростом технологических возможностей человечества увеличилось и число возможных причин, способных положить ему конец. От искусственного интеллекта, до ядерного оружия, люди, безусловно, могут найти способ уничтожить свою цивилизацию. Однако Армагеддон может произойти и без нашего участия.

В последние годы ученые выражают тревогу о том, что конец близок и человечество может прийти к полному вымиранию в течение ближайших 100 лет. Итак, что же может произойти? Вот 25 возможных сценариев окончания нашего мира, которые могут стать реальностью в течение ближайших 100 лет.

25. Контакт с внеземной жизнью

Фото: creativecommons.org

Проект поиска внеземного разума SETI (Search for Extraterrestrial Intelligence) активно посылает в космос сигналы, чтобы установить контакт с инопланетянами. Однако ученые, такие как Стивен Хокинг (Stephen Hawking), полагают, что это опасная игра может погубить всех нас. Подобно тому, как Колумб приплыл в Южную Америку и уничтожил коренное население континента, прибывшие на Землю инопланетяне, могут поступить с нами так же.

24. Зомби апокалипсис

Фото: barksdale.af.mil

Идея о том, что умершие воскреснут и станут убивать оставшихся в живых, кажется очень неправдоподобной. Однако существуют вполне научные возможности для зомби апокалипсиса, такие как некоторые паразиты головного мозга (коровье бешенство), наноботы и нейротоксины. Любая из этих причин может привести к тому, что люди начнут сходить с ума и убивать, впав в массовую ярость. Это возможно, но неправдоподобно.

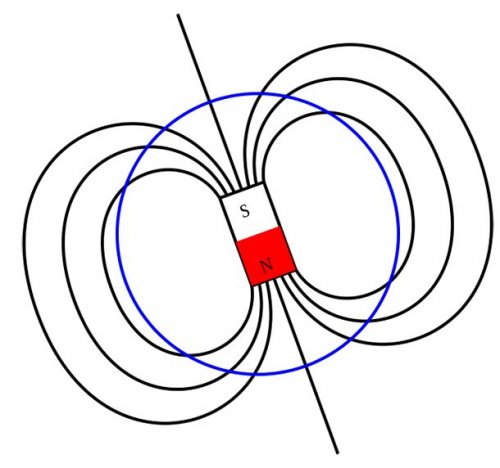

23. Смена земных полюсов

Фото: Wikipedia Commons.com

Если внезапно полюса Земли сменят свое положение, по мнению некоторых ученых, это может привести к тому, что мы станет уязвимыми для опасных частиц, попадающих на Землю из космоса. Такое, как полагают, уже случилось с Марсом: его атмосфера была уничтожена Солнцем из-за слабого магнитного поля планеты. Ученые считают, что такой же сценарий возможен и для Земли.

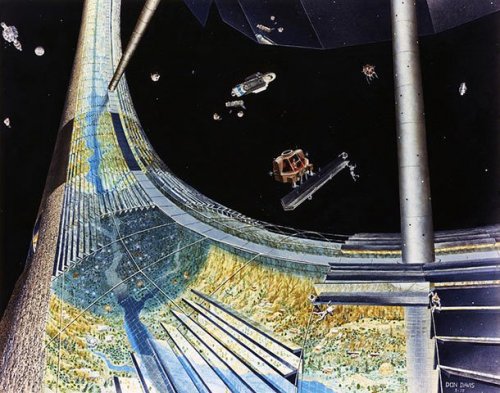

22. Восстание космических колоний

Фото: www.flickr.com

Космические колонии – вполне вероятное будущее человечества. НАСА уже работает над отправкой миссии на Марс, а создание колонии на Луне является частью этого плана. Жизнь в колониях может решить вопрос с перенаселенностью Земли и уменьшить количество отходов на планете. Однако это может стать и причиной проблемы. Что если космическая колония восстанет и атакует землю с помощью ядерного оружия? Поскольку они не будут бояться быть уничтоженными, то такое предложение может стать очень даже привлекательным для колонистов.

21. Искусственный интеллект

Фото: Wikipedia Commons.com

Компьютеры и искусственный интеллект уже заменяют собой тысячи рабочих мест, и вскоре для людей останется не так много работы. Как только компьютеры станут такими же умными и сознательными как Элон Маск (Elon Musk) и Стивен Хокинг (Стивен Хокинг), это может означать конец человечества…совсем как появление автомобилей стало в каком-то смысле концом для лошадей. Идея состоит в том, что люди сольются с ИИ, или ИИ уничтожит нас в широкомасштабной войне.

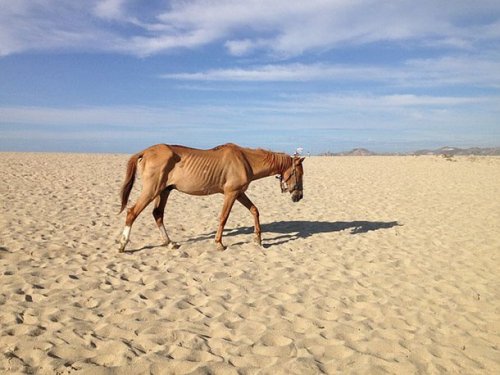

20. Разрушение среды обитания

Фото: Wikipedia Commons.com

Постоянный рост уровня человеческого потребления приводит к разрушению естественной среды обитания: страдают океаны, леса, пустыни и джунгли. Уничтожая естественные условия, мы тем самым уничтожаем многие виды растений и животных. Это может привести к целому ряду проблем, включая голод и экономический коллапс.

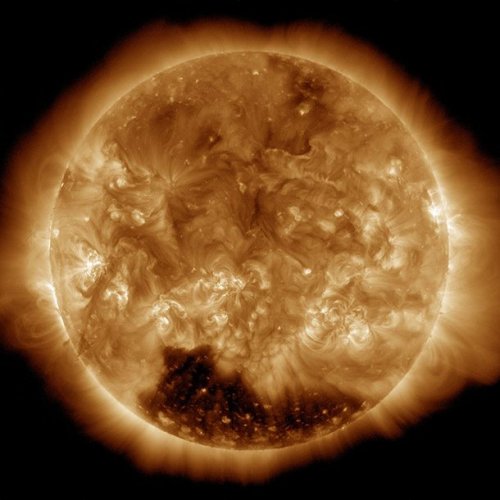

19. Смерть Солнца

Фото: WIkipedia Commons.com

В то время, как ученые полагают, что Солнце не умрет еще как минимум в течение 5 миллиардов лет, из которых Земля может рассчитывать на 1 миллиард, не исключено, что это произойдет раньше. Время от времени Солнце становится холоднее. Если бы в какой-то момент оно перестало давать достаточно тепла, Земля стала бы слишком холодной, чтобы на ней была возможна жизнь.

18. Супервулкан

Фото: WIkipedia Commons.com

Мы сидим на тикающей бомбе замедленного действия, которая называется земным ядром. Около 75 000 лет назад ядро Земли изверглось с огромной силой, что привело к появлению современной Индии. Это событие уничтожило 95% всех видов, населяющих планету. Ученые полагают, что в ближайшие 80 лет нас ожидает еще одно извержение. К счастью, если это случится, мы узнаем о приближении катаклизма благодаря тому, что Геологическая служба США (U.S. Geological Survey) следит за происходящими изменениями. Однако это, без сомнения, окажет мощное разрушительное влияние на жизнь на Земле.

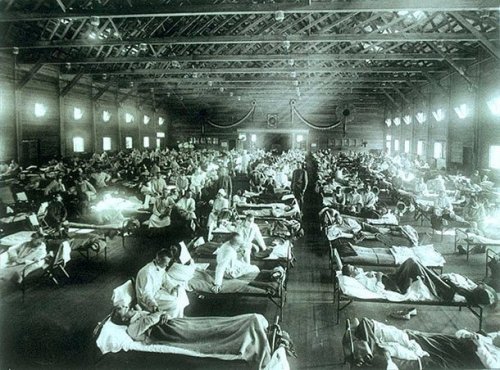

17. Пандемия, которую невозможно остановить

Фото: commons.wikimedia.org

Будет ли это атипичная пневмония, свиной грипп или вирусы Эбола, Зика, или какая-нибудь другая болезнь, существует очень высокая вероятность развития пандемии, которую мы не в состоянии будем остановить. Уже сегодня существуют заболевания устойчивые к антибиотикам. Если болезнь станет абсолютно устойчива к нашим лекарствам и станет распространяться как лесной пожар, она может дестабилизировать весь мир, обвалив экономику и сократив человеческую популяцию в наших местах обитания. Страх заражения, а также волнения и беспорядки приведут к вспышке новых войн, что погубит еще больше людей.

16. Перенаселение

Фото: www.flickr.com

Ученый, удостоенный множества наград, утверждает, что перенаселение, вероятно, приведет к нашему исчезновению в связи с ограниченностью природных ресурсов. С существующими сегодня технологиями, позволяющими продлевать жизнь, демографический бум, когда население достигнет девяти миллиардов человек, серьезно подорвет наши возможности всех прокормить. Отсутствие ресурсов приведет к экономической катастрофе и голоду во всем мире.

15. Проблема ускорителя частиц

Фото: Pixabay.com

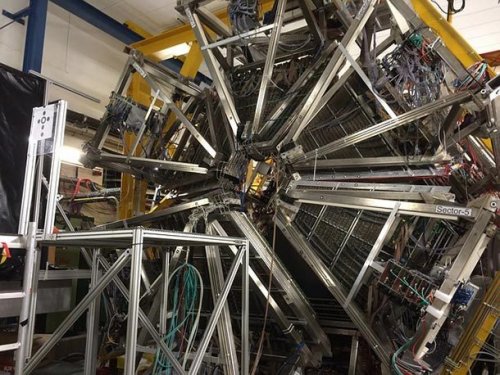

Ученые продолжают продвигать научные открытия. В случае с ускорителем частиц это может привести к катастрофическим последствиям. Несколько ученых и признанных экспертов в этой области озвучили опасения относительно обновления ускорителя частиц, который потенциально может создавать небольшие черные дыры, что приведет к уничтожению Земли в том виде, в котором мы ее знаем.

14. Нанотехнологическая катастрофа

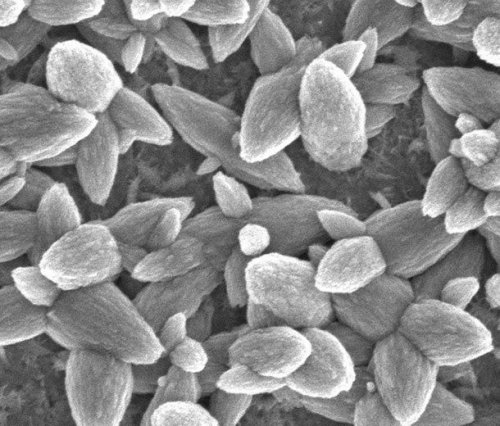

Фото: flickr.com

Нанотехнология – это возможность создавать компьютеры на атомном уровне. Уже сейчас ее разрабатывают для лечения рака и других заболеваний, однако, как утверждают, она может быть использована практически для всего, что нам нужно. В то же время, многие полагают, что в своем развитии нанотехнология способна разрушить мир. Хотя ученые говорят о том, что эта теория технически возможна, ее легко можно будет остановить.

13. Астероидное воздействие

Фото: flickr.com

Первый сценарий окончания жизни на Земле случился с участием динозавров и астероида потому, что они не смогли его остановить. Если бы такой же сценарий произошел с нами, это с большой вероятностью привело бы к уничтожению человечества и многих других живых существ на планете. К сожалению, в то время как Голливуд любит решать такие вопросы с помощью астронавтов и ядерного оружия, в действительности у НАСА нет способа как остановить мчащиеся к Земле астероиды. Если один из них несется к нам, вы, скорее всего, получите текстовое сообщение. Но не переживайте слишком сильно. Вероятность такого сценария невелика.

12. Божественное вмешательство

Фото: commons.wikimedia.org

Во многих мировых религиях сказано, как закончится мир. Согласно Христианскому учению, мир подвергнется ужасным гонениям и страданиям. Иисус вернется, чтобы спасти своих последователей, в то время как остальные останутся страдать.

В Исламе конец света называют «Часом». Иисус вернется в Дамаск, чтобы бороться с Антихристом, и это приведет к миру и процветанию, но, если он умрет естественной смертью, все в мире будет разрушено.

Согласно Индуизму, бог Вишну вернется на белом коне с мечом, подобным комете, и уничтожит силы зла.

Как бы это не происходило, всегда есть вероятность того, что конец всему положит некая божественная сила.

11. Солнечная буря

Фото: www.flickr.com

Солнечные вспышки происходят на Солнце постоянно. Однако, если бы разразилась большая солнечная буря, она могла бы вывести из строя навигационные системы и электрические сети на Земле. Результаты такого влияния окажутся разрушительными для экономики на всех континентах.

10. Мега-бомба

Фото: commons.wikimedia.org

Атомные бомбы, сброшенные на Хиросиму и Нагасаки, были ничтожно маленькими по сравнению с теми, которые производятся сегодня. Уже сегодня в России ведутся разработки по созданию бомбы, способной уничтожать целые народы. Можно только представить, что нам приготовили Соединенные Штаты или Китай. Нескольким мега-бомбам не нужно будет много времени, чтобы уничтожить миллионы людей, сокрушить мировую экономику и вернуть человечество в темные века.

9. Всплеск гамма-лучей

Фото: commons.wikimedia.org

Всплески гамма лучей – это очень быстрые и мощные потоки энергии, способные разрушать атомные частицы и убивать практически все, что попадается на пути. Небольшие всплески исходят от Солнца постоянно, но озоновый слой Земли способен блокировать их. Однако, если бы звезда, расположенная на расстоянии в 1000 световых лет от нас, рухнула в Черную дыру, она испустила бы массивный всплеск гамма-энергии. И если бы эта энергия двинулась в нашу сторону, то полностью уничтожила бы нашу галактику, а с ней и Землю. Пугает то, что, если это случится, мы не сможем понять, что происходит, пока не станет слишком поздно. К счастью, вероятность такого сценария очень мала.

8. Перезагрузка компьютера

Фото: www.flickr.com

Теория о том, что окружающий нас мир – всего лишь компьютерная симуляция, не такая сумасшедшая, какой может показаться. Многие физики пришли к заключению, что наш мир, действительно, может быть симуляцией, созданной высшим интеллектом. Если бы мы были в подобной компьютерной симуляции, то все, что нужно было для нашего исчезновения – чтобы Высший интеллект перезагрузил компьютер.

7. Всемирный голод

Фото: commons.wikimedia.org

Чтобы искоренить человечество, много не нужно. Просто уберите все наши продовольственные и водные ресурсы, и мы быстро исчезнем. Ядерная атака, вирус-убийца, чума, перенаселение или голод во всем мире, вероятно, станут основным способом достижения человечеством этой цели. К сожалению, в отличие от других причин, голод вполне вероятен.

6. Генетически измененные суперлюди

Фото: commons.wikimedia.org

С развитием генной инженерии ученые начнут модифицировать геномы всех новорожденных с тем, чтобы сделать людей быстрее, сильнее и умнее, чем мы есть сегодня. С появлением нового вида высоко интеллектуальных и продвинутых людей, Homo Sapiens пойдет по пути неандертальцев, систематически уничтожая и постепенно вытесняя более слабые виды, чтобы освободить место для новых видов.

5. Биотехнологическая катастрофа

Фото: Pixabay.com

Ученые любят вмешиваться в естественный порядок вещей. Во многих случаях они постоянно изменяют способы использования бактерий и биологических законов, чтобы излечить болезни и помочь человечеству. Однако, как и доктор Франкенштейн, из добрых побуждений ученые иногда создают монстров. Все, что потребуется для уничтожения человечества – какой-нибудь выпущенный в мир биологически модифицированный вирус, от которого нет лекарств.

4. Кибер-терроризм

Фото: Pexels.com

Поскольку мир становится все более зависимым от компьютеров, кибер-терроризм становится все более опасным как для экономики, так и для политики. Подобно биологической пандемии, если кто-нибудь создаст компьютерный вирус, это разрушит всю интернет и кибер-инфраструктуру, а также приведет к экономическому коллапсу и политическим потрясениям. И это не так неправдоподобно, как кажется. Многие полагают, что кибер-защита в мире недостаточно сильна для предотвращения некоторых атак.

3. Изменения климата

Фото: Pexels.com

В последнее время климатические изменения заботят многих ученых и мировых лидеров, и совершенно оправданно. Среди всех сценариев, способных привести к уничтожению нашего мира, изменение климата – самый вероятный. В то время, как некоторые ученые оптимистично полагают, что изменения можно замедлить и даже обратить вспять, другие считают, что уже слишком поздно, и мы мало что можем сделать. Климатические изменения могут привести к суровым погодным условиям, засухе, голоду и войне. Ситуация будет лишь усугубляться, пока все население не вымрет.

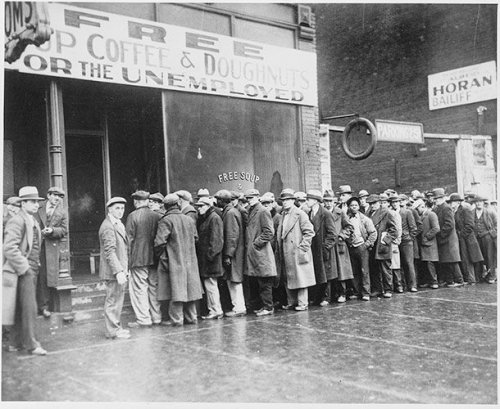

2. Всемирная депрессия

Фото: Wikipedia Commons.com

Великая депрессия стала первым мировым феноменом, затронувшим миллионы людей. В 2008 году экономический коллапс грозил обернуться еще одной депрессией, но, к счастью, дело не зашло так далеко. Многие полагают, что мы еще может скатиться в депрессию, даже более тяжелую, чем раньше, которая негативно повлияет на мировую экономику. Во время Всемирной депрессии миллионы людей потеряют работу, будут голодать и умирать. Возможно разразиться вооруженный конфликт, что приведет к Третьей мировой войне.

1. Ядерная война

Фото: Wikipedia Commons.com

Третья мировая война будет ядерной. В мире насчитывается около 15 000 единиц ядерного оружия. У большинства стран не будет возможности использовать оружие до тех пор, пока Россия и Соединенные Штаты не откроют свои массивные запасы. Но в тот момент это не имело бы значения, поскольку для полного уничтожения жизни на Земле понадобилось бы всего от 50 до 100 единиц. Если бы вы не погибли от взрывов, истощение озонового слоя в сочетании с ядерной зимой уничтожило бы на планете большую часть того, что можно употреблять в пищу, что явилось бы причиной голода. От него погибли бы те, кто остался в живых после ядерной войны.

Перепечатка статей разрешена только при наличии активной индексируемой ссылки на BUGAGA.RU

Нам, как части системы, кажется, что она непоколебима, бессмертна. Кажется, что люди появились так давно и заняли такую нишу, что всё нам нипочём. Ложное, конечно, представление. Достаточно взглянуть на результаты относительно небольших в масштабе планеты природных катаклизмов. Наводнения, ураганы, даже внезапные изменения температуры всего на несколько градусов всегда уносят множество жизней. Всего одно извержение вулкана может поставить крест не только на нашей цивилизации, но и на целом явлении под названием «жизнь». Давай рассмотрим некоторые не самые популярные сценарии гибели человечества.

Добровольное вымирание

Экологи тоже могут быть радикалами, например организация VHEMT. Это международное движение за добровольное вымирание человечества. Успеха предполагается достичь за счёт отказа от размножения. Идея экологов-радикалов заключается в том, что для биосферы Земли будет лучше, если человечество перестанет существовать. Сам человеческий вид в рамках данной концепции рассматривается как некий экзотический захватчик, популяция которого вышла из-под контроля и представляет собой угрозу всем остальным живым организмам. Естественный порядок вещей и гармонию с природой можно восстановить только после полного вымирания вида Homo sapiens.

Лозунг движения: «Жить долго и счастливо вымереть». Кроме добровольного вымирания пропагандируются убийства, самоубийства и массовая стерилизация.

Серая слизь

Одна из гипотетических угроз заключается в развитии нанотехнологий. Что, если однажды будут созданы нанороботы, способные воспроизводить свои копии из подручных материалов, и что, если этот процесс выйдет из-под контроля?

Сценарий выглядит так. Первый репликатор собирает свою копию за тысячу секунд; затем уже два репликатора собирают ещё двоих за следующую тысячу секунд; четыре собирают ещё четырех и так далее. Менее чем за день они наберут вес в тонну, за два дня они будут весить больше, чем Земля. Таким образом, экосистема Земли может быть полностью уничтожена. Всё вещество планеты будет переработано и преобразовано в огромное количество самовоспроизводящихся роботов. Экстремальный сценарий предполагает, что после «переработки» планеты нанороботы продолжат распространяться по Солнечной системе, а в конечном итоге израсходуют всё вещество целой Вселенной.

Технологическая сингулярность

Эволюция, помноженная на технологическое развитие, может превратиться в технологическую сингулярность. Это когда технологический прогресс станет настолько быстрым и сложным, что окажется недоступным пониманию людей. Такое может произойти после создания искусственного интеллекта, самовоспроизводящихся машин и слияния человека с машинами. В теории такое положение называется постгуманизмом, то есть эпохой, когда человек перестанет быть человеком, а впоследствии проиграет конкурентную борьбу машинам.

Ряд аналитиков утверждает, что начнётся эра технологической сингулярности уже в самом ближайшем будущем, примерно в 2040-х годах. Уже сейчас в каждом доме такое количество интегральных схем (микропроцессоров), какое ещё несколько десятков лет назад приходилось на целый город. С каждым годом их число увеличивается, а степень интеграции с человеком и сложность возрастает. Возможно, прорывной точкой станет повсеместное внедрение технологий дополненной реальности, которая со временем вытеснит реальность реальную.

Трансгуманизм: как мы изменимся, когда сольемся с ИИ и технологиями

Биотехнологический терроризм

Биохакеры — это люди, не только проводящие независимые биологические исследования, но и самостоятельно создающие исследовательское оборудование для генетического редактирования. Эти энтузиасты придерживаются хакерских принципов, а именно открытого исходного кода, то есть у покупателя остаётся возможность контролировать, настраивать и автоматизировать приобретенную систему. Покупателем может оказаться кто угодно, а следовательно, однажды мир может столкнуться с биотехнологическим терроризмом.

Например, однажды появятся недорогие биопринтеры, на которых злоумышленники могут распечатать изменённые органы, лишив будущих носителей репродуктивной функции либо поместив в эти органы какие-то вирусы. Таким «террористом» может выступить крупная транснациональная корпорация. Сначала распространяются органы с дефектом, а потом предлагается способ избавления от него. Однако процесс может выйти из-под контроля — представь это как если бы до таких технологий допустили разработчиков инди-игр. С той разницей, что на рынок они будут выпускать не третьесортные игры, а импланты и органы.

Гамма-всплеск

Наиболее реальные и, что главное, непредсказуемые угрозы виду могут прийти из космоса. Классика жанра: гигантский метеорит, от которого у нас всё ещё нет никакой защиты. Но метеорит всё-таки можно обнаружить заранее, его можно попытаться сбить или разрушить. Куда большую опасность представляют гамма-всплески. С ними вообще ничего нельзя сделать, и обнаружить их получится только по факту, когда уже слишком поздно.

Гамма-всплеск — это выброс колоссальной энергии, рождение сверхновой. Всего за несколько секунд высвобождается энергия, равная той, которую Солнце выделяет за несколько миллиардов лет. Это можно представить как сравнительно узкий луч мощного излучения, и если на пути этого луча окажется Земля, то на одной её половине мгновенно умрёт всё живое, а остальные погибнут в ближайшие дни, может быть недели. Этот всплеск просто уничтожит, можно сказать, сдует атмосферу планеты. Происходит такое событие довольно редко, но если оно произойдёт — у человечества на Земле не будет шансов на выживание.

Неизбежность и обречённость

Вообще-то, все мы обречены с момента зарождения жизни: то, что даровало нам жизнь, Солнце, однажды станет смертельной угрозой. Мы уже прошли экватор жизненного цикла планеты, и через 150–200 миллионов лет жизнь будет невозможна на этой планете. Вроде бы время ещё есть — если не выпилимся каким-то из перечисленных способов, успеем свалить на другую планету. Но и эти «скачки» не смогут длиться вечно.

Коллапс всей Вселенной — это то, что однажды произойдёт, и то, чего никто не переживёт. Сценариев несколько, например тепловая смерть Вселенной. Если она будет бесконечно расширяться, то со временем энергия «размажется» таким узким слоем, что Вселенная просто замёрзнет — в любой её точке температура будет в районе абсолютного нуля. Другой сценарий рассматривает вариант Большого сжатия, по аналогии с Большим взрывом. Вселенная, достигнув максимального размера, начнёт сжиматься обратно и в итоге снова соберётся в одной точке, после чего последует новый Большой взрыв.

Великая пустота и другие загадочные объекты Вселенной

Эксперты из шведского Фонда глобальных проблем провели исследование с Институтом будущего человечества Оксфордского университета на тему возможных причин вымирания человеческого вида. Выяснилось, что наибольшую опасность (10%) для людей несёт искусственный интеллект, который может стремиться к саморазвитию и потреблению максимального количества ресурсов. Не исключается, что человечество однажды может стать для него преградой.

Что касается ядерной войны, то здесь шансы оцениваются всего в 5%. Столько же учёные отвели возможной пандемии, фатальным изменениям климата и неизвестным глобальным угрозам. Ещё меньше у экологического коллапса и изобретения супероружия с помощью нанотехнологий.

Всего 1% специалисты отдали искусственно созданным патогенам, а огромному метеориту и того меньше — одну сотую. Наименьшую же опасность для нас представляют супервулканы. По мнению учёных, вероятность лавового апокалипсиса оценивается в две тысячных процента, говорится в материале РИА «Новости».

Лайф писал, что треть учёных считают, что искусственный интеллект может спровоцировать ядерную войну. При этом научное сообщество до сих пор не может солидаризироваться вокруг одной точки зрения на ИИ.

-

Синоптики рассказали, когда в Москву придёт зима с морозами и снегопадами

13 ноября 2022, 12:02

-

Прибывшего на саммит G20 Лаврова встретили почётный караул и танцовщицы

13 ноября 2022, 12:01

-

В США предсказали приостановку боевых действий на Украине на полгода

13 ноября 2022, 11:57

Нибиру. Планета Х. Апокалипсис календаря майя. Раскол. Новый Великий потоп. Неудержимое пламя. Библейское пророчество. Супервулкан. Бродячий астероид или комета. Каждые несколько лет (или даже несколько месяцев, в зависимости от того, в какой части Интернета вы привыкли обитать) новая история, слухи или конспирологическая теория сходят с ума, возвещая конец света. Некоторые заявления весьма специфичны; другие более размыты. Но мы ведь не живем в мире, в котором миф и мистика преобладают над здравым смыслом; мы знаем, что можем отделить зерна истины от плевел мифов, используя прогностическую силу науки. И насколько нам известно, есть четыре сценария настоящего конца света, то есть Земли, и все они однажды случатся, к бабке не ходи. Итан Зигель с Medium.com считает, что это ультимативный конец.

Красочный сценарий разрушения планеты

Содержание

- 1 Вымирание человечества

- 2 Кипячение земных океанов

- 3 Истощение до бесплодных земель

- 4 Проглоченная или выброшенная?

Вымирание человечества

Это не просто пророчества — это неизбежность. Несмотря на то, что сегодня нас более семи миллиардов человек и это число постоянно растет, в нынешней форме люди живут меньше миллиона лет, а все высшие приматы жили всего несколько миллионов лет. Эволюция может казаться вяло текущей для нашего вида, если судить в рамках одной человеческой жизни, но за миллионы лет она становится неотвратимой. Земля меняется, и давление на разные виды тоже меняется, происходят случайные генетические мутации. Некоторые мутации полезны для выживания вида в условиях внешнего давления, и они, скорее всего, будут переданы вместе с генами грядущим поколениям.

Говоря с позиции эволюции, человеческие существа — или homo sapiens — существовали лишь короткий миг: менее полумиллиона лет. И насколько нам известны пути эволюции, уже через несколько миллионов лет людей на планете не будет

Какая часть поколения будущих людей сохранит эти гены — это уже неважно; даже если через миллионы лет потомки современных людей все еще будут ходить по земле, они уже не будут людьми. Люди сами сталкиваются с давлением меняющейся планеты с ограниченными ресурсами, других людей (в форме ядерного, химического или биологического окружения) и природы (в форме болезней). Будет ли он по вине катастрофы, падения астероида, случится или нет, конец человечества неизбежен. Мы просто вымрем в этом мире, и неважно, выживут наши потомки или нет. В геологических и астрономических масштабах это случится скорее раньше, чем позже, и станет первым «концом света» для нас.

Сегодня на Земле вода в океанах, как правило, закипает, когда в нее входит лава или какой-то другой перегретый материал. Но в далеком будущем энергии Солнца будет достаточно для того, чтобы кипятить воду в глобальных масштабах. Фото.» width=»800″ height=»447″ class=»size-full wp-image-273747″ title=»Вымирание человечества. >Сегодня на Земле вода в океанах, как правило, закипает, когда в нее входит лава или какой-то другой перегретый материал. Но в далеком будущем энергии Солнца будет достаточно для того, чтобы кипятить воду в глобальных масштабах.»>

>Сегодня на Земле вода в океанах, как правило, закипает, когда в нее входит лава или какой-то другой перегретый материал. Но в далеком будущем энергии Солнца будет достаточно для того, чтобы кипятить воду в глобальных масштабах

Заходите в наш специальный Telegram-чат. Там всегда есть с кем обсудить новости из мира высоких технологий.

Кипячение земных океанов

Нам серьезно повезло, что мы оказались на планете именно таких размеров и массы, с такой атмосферой и на таком же расстоянии от звезды, как оказались. Только нужная комбинация всех этих параметров позволила сложиться планете с жизнью и обилием жидкой воды на поверхности. На протяжении миллиардов лет Земля была миром, покрытым океаном, с простой и сложной жизнью, которая обитала в этом океане и только недавно вылезла на сушу. Однако благодаря будущей эволюции нашего Солнца, нашим океанам не суждено быть вечно здесь. Когда гелий накопится в ядре Солнца, область, в которой протекает термоядерный синтез, расширится, со всеми вытекающими для нас последствиями.

Этот срез демонстрирует различные регионы поверхности и недр нашего Солнца, включая ядро, где протекает ядерный синтез. Время идет, и однажды сжигающий гелий регион ядра расширится, а вместе с тем увеличится и энергетический выход солнца

Со временем Солнце нагреется и расширится, станет ярче и будет излучать больше энергии. Через один-другой миллиард лет, не больше, количество выделяемой солнцем энергии увеличится до определенной критической точки: достаточно высокой, чтобы количество энергии, попадающей в молекулу воды в океане Земли в течении дня, ее вскипятило. Наша планета станет больше похожей на Венеру, чем на Землю, и станет совершенно непригодной для жизни на поверхности. Впрочем, простейшие организмы наверняка смогут ужиться поверх облаков, но известной нам жизни все-таки придет конец. Космический эксперимент по выращиванию сложных организмов придет к своему естественному завершению.

Примерно через пять-семь миллиардов лет в ядре Солнца будет исчерпан водород. Внутренняя часть светила сократится, нагреется и начнет синтез гелия. И тогда Солнце расширится, испарит земную атмосферу и поджарит поверхность планеты

Истощение до бесплодных земель

Думали, кипящие океаны — это плохо? Как насчет перспективы того, что каждый атом атмосферы будет выброшен из нашего мира? Все когда-либо живущее на поверхности обратится в пепел? Следы, оставленные живыми существами, превратятся в пыль? Если будет достаточно тепла и энергии, это можно сделать с любым миром, и Меркурий, ближайшая к Солнцу планета, являет собой яркий пример. Пройдет еще пять-семь миллиардов лет — и такая же судьба постигнет Землю, когда у Солнца кончится водородное топливо. И тогда ядро сожмется, нагреется и начнет синтезировать гелий, испуская еще больше энергии. В таком состоянии Солнце превратится в сжигающий гелий красный гигант, и ничто на Земле не сможет ему противостоять.

Когда Солнце станет истинным красным гигантом, сама Земля не будет проглочена или поглощена, она будет поджарена

Подписывайтесь на наш канал в Яндекс Дзен. Там можно найти много всего интересного, чего нет даже на нашем сайте.

Солнце увеличится в сотни раз по сравнению с его нынешним диаметром и станет в тысячи раз ярче, чем сегодня. Земля будет почти полностью обрита, а также оттолкнута от Солнца; Меркурий и Венера будут полностью поглощены. Позднее Солнце умрет, уменьшится до белого карлика, а Земля останется жареным остатком, плавающим в космосе на своей орбите вокруг трупа звезды.

Даже единичные гравитационные взаимодействия с большими проходящими массами могут привести к нарушению орбиты и выбросу крупного тела из солнечной и планетарной системы

Проглоченная или выброшенная?

Очищенная от жизни, сваренная, а затем обугленная и осушенная, стерилизованная квадриллионами космических лучей, наша планета будет продолжать свое существование. Она останется нетронутой, блуждая вокруг трупика нашей звезды, пока не произойдет одно из следующих событий:

- Какой-либо объект столкнется с Землей, уничтожив или поглотив ее, в зависимости от размера и скорости столкновения. Наша галактика — довольно обширное место, но столкновения регулярно происходят по всей Вселенной.

- Массивный объект пройдет рядом с Землей, выбросит ее из Солнечной системы и галактики, после чего та будет блуждать в одиночестве в пустоте космоса целую вечность.

- Или она останется привязанной к трупу Солнца и медленно, очень медленно, будет по спирали спускаться к ее звездному трупу, где затем будет поглощена черным карликом.

После того как Солнце станет черным карликом, если ничто не выбросит и не столкнется с останками Земли, гравитация столкнет планету с бывшим светилом

И вот тогда миру точно настанет конец. Все эти четыре сценария — не просто болтовня, это стопроцентные прогнозы на будущее нашей планеты, подкрепленные нашими лучшими научными достижениями. Далекое будущее Земли известно; ближайшее будущее нам придется сотворить самостоятельно. Создать будущее, прочно закрепившись в научной реальности, используя лучшие знания и самые успешные теории, чтобы обеспечить безопасность, свободу и процветание человечества, — это конечная мечта научно образованного общества. Остается надеяться, что мы сможем отложить «конец» света как можно дальше в будущее.

For methodological challenges quantifying and mitigating the risk, proposed mitigation measures, and related organizations, see Global catastrophic risk.

Nuclear war is an often-predicted cause of the extinction of humankind.[1]

Human extinction is the hypothetical end of the human species due to either natural causes such as population decline from sub-replacement fertility, an asteroid impact, large-scale volcanism, or to anthropogenic (human) causes.

For the latter, some of the many possible contributors include climate change, global nuclear annihilation, biological warfare, and ecological collapse. Other scenarios center on emerging technologies, such as advanced artificial intelligence, biotechnology, or self-replicating nanobots.

The scientific consensus is that there is a relatively low risk of near-term human extinction due to natural causes.[2][3] The likelihood of human extinction through humankind’s own activities, however, is a current area of research and debate.

History of thought[edit]

Early history of thinking about human extinction[edit]

Before the 18th and 19th centuries, the possibility that humans or other organisms could become extinct was viewed with scepticism.[4] It contradicted the principle of plenitude, a doctrine that all possible things exist.[4] The principle traces back to Aristotle, and was an important tenet of Christian theology.[5] Ancient Western philosophers such as Plato, Aristotle, and Lucretius wrote of the end of humankind only as part of a cycle of renewal. Later philosophers such as Al-Ghazali, William of Ockham, and Gerolamo Cardano expanded the study of logic and probability and began discussing abstract possible worlds, including a world without humans. Physicist Edmond Halley stated that the extinction of the human race may be beneficial to the future of the world.[6]

The notion that species can become extinct gained scientific acceptance during the Age of Enlightenment in the 17th and 18th centuries, and by 1800 Georges Cuvier had identified 23 extinct prehistoric species.[4] The doctrine was further gradually undermined by evidence from the natural sciences, particular the discovery of fossil evidence of species that appeared to no longer exist, and the development of theories of evolution.[5] In On the Origin of Species, Darwin discussed the extinction of species as a natural process and core component of natural selection.[7] Notably, Darwin was skeptical of the possibility of sudden extinctions, viewing it as a gradual process. He held that the abrupt disappearances of species from the fossil record were not evidence of catastrophic extinctions, but rather were a function of unrecognised gaps in the record.[7]

As the possibility of extinction became more widely established in the sciences, so did the prospect of human extinction.[4] In the 19th century, human extinction became a popular topic in science (e.g., Thomas Robert Malthus’s An Essay on the Principle of Population) and fiction (e.g., Mary Shelley’s The Last Man). In 1863, a few years after Charles Darwin published On the Origin of Species, William King proposed that Neanderthals were an extinct species of the genus Homo. The Romantic authors and poets were particularly interested in the topic.[4] Lord Byron wrote about the extinction of life on earth in his 1816 poem «Darkness», and in 1824 envisaged humanity being threatened by a comet impact, and employing a missile system to defend against it.[4] Mary Shelley’s 1826 novel The Last Man is set in a world where humanity has been nearly destroyed by a mysterious plague.[4] At the turn of the 20th century, Russian cosmism, a precursor to modern transhumanism, advocated avoiding humanity’s extinction by colonizing space.[4]

Atomic era[edit]

The invention of the atomic bomb prompted a wave of discussion about the risk of human extinction among scientists, intellectuals, and the public at large.[4] In a 1945 essay, Bertrand Russell wrote that «[T]he prospect for the human race is sombre beyond all precedent. Mankind are faced with a clear-cut alternative: either we shall all perish, or we shall have to acquire some slight degree of common sense.»[8] In 1950, Leo Szilard suggested it was technologically feasible to build a cobalt bomb that could render the planet unlivable. A 1950 Gallup poll found that 19% of Americans believed that another world war would mean «an end to mankind».[9] Rachel Carson’s 1962 Silent Spring raised awareness of environmental catastrophe. In 1983, Brandon Carter proposed the Doomsday argument, which used Bayesian probability to predict the total number of humans that will ever exist.

The discovery of «nuclear winter» in the early 1980s, a specific mechanism by which nuclear war could result in human extinction, again raised the issue to prominence. Writing about these findings in 1983, Carl Sagan argued that measuring the severity of extinction solely in terms of those who die «conceals its full impact», and that nuclear war «imperils all of our descendants, for as long as there will be humans.»[10]

Post Cold War[edit]

John Leslie’s 1996 book The End of The World was an academic treatment of the science and ethics of human extinction. In it, Leslie considered a range of threats to humanity and what they have in common. In 2003, British Astronomer Royal Sir Martin Rees published Our Final Hour, in which he argues that advances in certain technologies create new threats for the survival of humankind and that the 21st century may be a critical moment in history when humanity’s fate is decided.[11] Edited by Nick Bostrom and Milan M. Ćirković, Global Catastrophic Risks was published in 2008, a collection of essays from 26 academics on various global catastrophic and existential risks.[12] Toby Ord’s 2020 book The Precipice: Existential Risk and the Future of Humanity argues that preventing existential risks is one of the most important moral issues of our time. The book discusses, quantifies, and compares different existential risks, concluding that the greatest risks are presented by unaligned artificial intelligence and biotechnology.[13]

Causes[edit]

Potential anthropogenic causes of human extinction include global thermonuclear war, deployment of a highly effective biological weapon, an ecological collapse, runaway artificial intelligence, runaway nanotechnology (such as a grey goo scenario), a scientific accident involving a micro black hole or vacuum metastability disaster, overpopulation and increased consumption pose the risk of resource depletion and a concomitant population crash, population decline by choosing to have fewer children, displacement of naturally evolved humans by a new species produced by genetic engineering or technological augmentation. Natural and external extinction risks include high-fatality-rate pandemic, supervolcanic eruption, asteroid impact, nearby supernova or gamma-ray bursts, extreme solar flare, or alien invasion.

Without intervention by unexpected forces, the stellar evolution of the Sun is expected to make Earth uninhabitable, then destroy it. Depending on its ultimate fate, the entire universe may eventually become uninhabitable.

Probability[edit]

Natural vs. anthropogenic[edit]

Experts generally agree that anthropogenic existential risks are (much) more likely than natural risks.[14][11][15][2][16] A key difference between these risk types is that empirical evidence can place an upper bound on the level of natural risk.[2] Humanity has existed for at least 200,000 years, over which it has been subject to a roughly constant level of natural risk. If the natural risk were sufficiently high, then it would be highly unlikely that humanity would have survived as long as it has. Based on a formalization of this argument, researchers have concluded that we can be confident that natural risk is lower than 1 in 14,000 per year.[2]

Another empirical method to study the likelihood of certain natural risks is to investigate the geological record.[14] For example, a comet or asteroid impact event sufficient in scale to cause an impact winter that would cause human extinction before the year 2100 has been estimated at one-in-a-million.[17][18] Moreover, large supervolcano eruptions may cause a volcanic winter that could endanger the survival of humanity.[19] The geological record suggests that supervolcanic eruptions are estimated to occur on average about once every 50,000 years, though most such eruptions would not reach the scale required to cause human extinction.[19] Famously, the supervolcano Mt. Toba may have almost wiped out humanity at the time of its last eruption (though this is contentious).[19][20]

Since anthropogenic risk is a relatively recent phenomenon, humanity’s track record of survival cannot provide similar assurances.[2] Humanity has only survived 77 years since the creation of nuclear weapons, and for future technologies, there is no track record at all. This has led thinkers like Carl Sagan to conclude that humanity is currently in a «time of perils»[21] – a uniquely dangerous period in human history, where it is subject to unprecedented levels of risk, beginning from when humans first started posing risk to themselves through their actions.[14][22]

Risk estimates[edit]

Given the limitations of ordinary observation and modeling, expert elicitation is frequently used instead to obtain probability estimates.[23] In 2008, an informal survey of experts at a conference hosted by the Future of Humanity Institute estimated a 19% risk of human extinction by the year 2100, though, given the survey’s limitations, these results should be taken «with a grain of salt».[15]

Risk Estimated probability

for human extinction

before 2100Overall probability 19%

Molecular nanotechnology weapons 5%

Superintelligent AI 5%

All wars (including civil wars) 4%

Engineered pandemic 2%

Nuclear war 1%

Nanotechnology accident 0.5%

Natural pandemic 0.05%

Nuclear terrorism 0.03%

Table source: Future of Humanity Institute, 2008.[15]

There have been a number of other estimates of existential risk, extinction risk, or a global collapse of civilization:

- Humanity has a 95% probability of being extinct in 7,800,000 years, according to J. Richard Gott’s formulation of the controversial Doomsday argument, which argues that we have probably already lived through half the duration of human history.[24]

- In 1996, John Leslie estimated a 30% risk over the next five centuries (equivalent to around 9% per century, on average).[25]

- In 2003, Martin Rees estimated a 50% chance of collapse of civilisation in the twenty-first century.[26]

- The Global Challenges Foundation’s 2016 annual report estimates an annual probability of human extinction of at least 0.05% per year.[27]

- A 2016 survey of AI experts found a median estimate of 5% that human-level AI would cause an outcome that was «extremely bad (e.g. human extinction)».[28]

- In 2020, Toby Ord estimates existential risk in the next century at «1 in 6» in his book The Precipice: Existential Risk and the Future of Humanity.[14][29]

- Metaculus users currently estimate a 3% probability of humanity going extinct before 2100.[30]

- In a 2010 interview with The Australian, Australian scientist Frank Fenner predicted the extinction of the human race within a century, primarily as the result of human overpopulation, environmental degradation and climate change.[31]

- According to a 2020 study published in Scientific Reports, if deforestation and resource consumption continue at current rates, they could culminate in a «catastrophic collapse in human population» and possibly «an irreversible collapse of our civilization» in the next 20 to 40 years. According to the most optimistic scenario provided by the study, the chances that human civilization survives are smaller than 10%. To avoid this collapse, the study says, humanity should pass from a civilization dominated by the economy to a «cultural society» that «privileges the interest of the ecosystem above the individual interest of its components, but eventually in accordance with the overall communal interest.»[32][33]

- Nick Bostrom, a philosopher at the University of Oxford known for his work on existential risk, argues that it would be «misguided»[34] to assume that the probability of near-term extinction is less than 25% and that it will be «a tall order» for the human race to «get our precautions sufficiently right the first time», given that an existential risk provides no opportunity to learn from failure.[3][17]

- Philosopher John Leslie assigns a 70% chance of humanity surviving the next five centuries, based partly on the controversial philosophical doomsday argument that Leslie champions. Leslie’s argument is somewhat frequentist, based on the observation that human extinction has never been observed, but requires subjective anthropic arguments.[35] Leslie also discusses the anthropic survivorship bias (which he calls an «observational selection» effect on page 139) and states that the a priori certainty of observing an «undisastrous past» could make it difficult to argue that we must be safe because nothing terrible has yet occurred. He quotes Holger Bech Nielsen’s formulation: «We do not even know if there should exist some extremely dangerous decay of say the proton which caused the eradication of the earth, because if it happens we would no longer be there to observe it and if it does not happen there is nothing to observe.»[36]

- Jean-Marc Salotti calculated the probability of human extinction caused by a giant asteroid impact.[37] It is between 0.03 and 0.3 for the next billion years, if there is no colonization of other planets. According to that study, the most frightening object is a giant long-period comet with a warning time of a few years only and therefore no time for any intervention in space or settlement on the Moon or Mars. The probability of a giant comet impact in the next hundred years is 2.2E-12.[37]

Individual vs. species risks[edit]

Although existential risks are less manageable by individuals than – for example – health risks, according to Ken Olum, Joshua Knobe, and Alexander Vilenkin, the possibility of human extinction does have practical implications. For instance, if the «universal» Doomsday argument is accepted it changes the most likely source of disasters, and hence the most efficient means of preventing them. They write: «… you should be more concerned that a large number of asteroids have not yet been detected than about the particular orbit of each one. You should not worry especially about the chance that some specific nearby star will become a supernova, but more about the chance that supernovas are more deadly to nearby life than we believe.»[38]

Difficulty[edit]

Some scholars argue that certain scenarios such as global thermonuclear war would have difficulty eradicating every last settlement on Earth. Physicist Willard Wells points out that any credible extinction scenario would have to reach into a diverse set of areas, including the underground subways of major cities, the mountains of Tibet, the remotest islands of the South Pacific, and even to McMurdo Station in Antarctica, which has contingency plans and supplies for long isolation.[39] In addition, elaborate bunkers exist for government leaders to occupy during a nuclear war.[17] The existence of nuclear submarines, which can stay hundreds of meters deep in the ocean for potentially years at a time, should also be considered. Any number of events could lead to a massive loss of human life, but if the last few (see minimum viable population) most resilient humans are unlikely to also die off, then that particular human extinction scenario may not seem credible.[40]

Ethics[edit]

Value of human life[edit]

«Existential risks» are risks that threaten the entire future of humanity, whether by causing human extinction or by otherwise permanently crippling human progress.[3] Multiple scholars have argued based on the size of the «cosmic endowment» that because of the inconceivably large number of potential future lives that are at stake, even small reductions of existential risk have great value.

In one of the earliest discussions of ethics of human extinction, Derek Parfit offers the following thought experiment:[41]

I believe that if we destroy mankind, as we now can, this outcome will be much worse than most people think. Compare three outcomes:

(1) Peace.

(2) A nuclear war that kills 99% of the world’s existing population.